Os ataques na Web têm aumentado continuamente à medida que mais e mais empresas fornecem conectividade on-line e remota para seus aplicativos. É extremamente importante garantir que esses aplicativos e os ativos da empresa estejam protegidos contra ransomware, bots, DDoS, injeção de SQL, scripts, ataques e outros riscos.

Ao longo dos anos, a indústria de tecnologia criou vários tipos de ransomware e métodos de recuperação de ataques. Mitigar esses ataques antes que eles aconteçam pode eliminar o caro processo de recuperação do impacto nos dados e nos negócios. A introdução de controles de segurança avançados pode reduzir a perda de dados e o tempo de inatividade como resultado desses ataques.

Ao considerar migrar para o VMware Cloud on AWS ou já o fez, você pode ter a necessidade de proteger os servidores da Web que residem em um ambiente vSphere na infraestrutura global da Amazon Web Services (AWS).

Para fornecer um aspecto de segurança para essas cargas de trabalho, você pode aproveitar alguns serviços nativos da AWS. Dependendo da sua arquitetura, os firewalls e balanceadores de carga de aplicativos da web locais tradicionais podem não funcionar da mesma maneira no VMware Cloud on AWS. Para resolver isso, você pode aproveitar o AWS WAF , um firewall de aplicativo da web que ajuda a proteger seus aplicativos ou APIs contra exploits e bots comuns da web.

O VMware Cloud on AWS é um serviço totalmente gerenciado desenvolvido em conjunto pela AWS e pela VMware. Ele fornece uma infraestrutura de data center definido por software (SDDC) da VMware com a mesma aparência das infraestruturas vSphere locais de muitas empresas. Ele também inclui armazenamento definido por software e tecnologias de rede da VMware vSAN e VMware NSX.

O AWS WAF fornece verificação de tráfego HTTP/HTTPS designado para proteger contra vários ataques. Os conjuntos de regras WAF ACL definem o tráfego aceitável ou mal-intencionado e podem ser atualizados em minutos em todas as implantações do AWS WAF aproveitando o AWS Firewall Manager .

Conjuntos de regras pré-configurados estão disponíveis pela AWS por meio do console WAF ACL, ou conjuntos de regras de terceiros podem ser adquiridos por meio do AWS Marketplace . Outros controles de segurança também estão disponíveis para uso com o AWS WAF, e o Amazon CloudWatch pode ser usado para monitorar métricas, logs e alertas.

Considerações de projeto

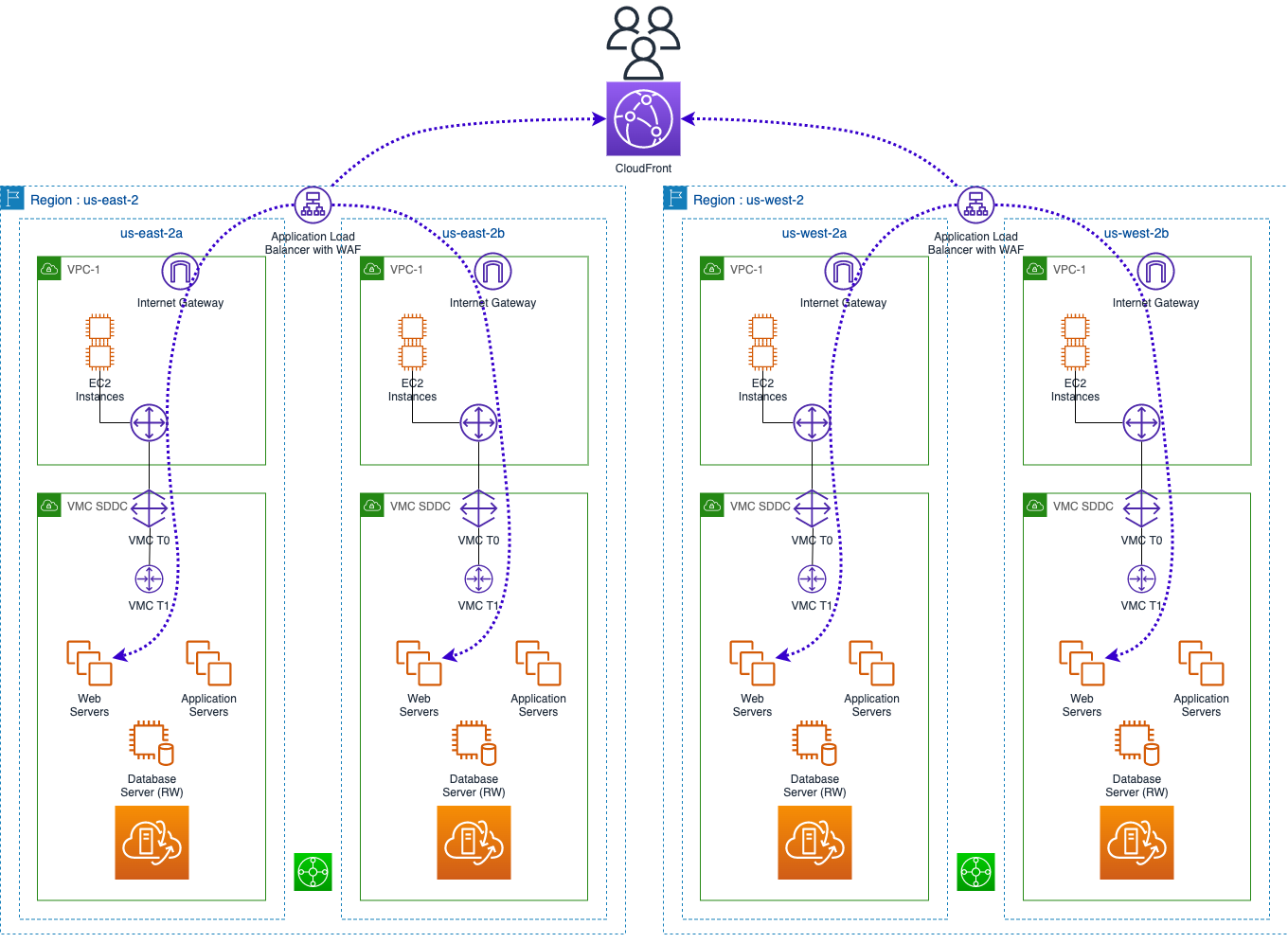

À medida que começamos a desenvolver esses serviços, algumas decisões de design precisam ser tomadas, como fornecer uma região da AWS e uma zona de disponibilidade (AZ) para nossos componentes de infraestrutura. Isso inclui VMware Cloud on AWS SDDC(s), Amazon Virtual Private Clouds (VPCs) nativas e possivelmente outros serviços nativos da AWS de suporte.

Ao determinar esses locais, considere os locais a partir dos quais os serviços serão acessados. Por exemplo, se os usuários residirem na costa leste dos Estados Unidos, criaríamos esses serviços nas regiões us-east-1 ou us-east-2. Da mesma forma, se os usuários residirem na costa oeste ou na Europa, criaremos esses serviços nas respectivas regiões mais próximas. Se os usuários estiverem em várias regiões, podemos considerar um design multirregional.

O AWS CloudFront fornece recursos de entrega global e é um serviço de distribuição de conteúdo que pode entregar conteúdo muito mais próximo dos usuários finais por meio de mais de 225 pontos de presença (PoPs). Para este exemplo, escolheremos um Application Load Balancer (ALB). Outras considerações de design incluem como nosso aplicativo da web operará no VMware Cloud on AWS e como o tráfego fluirá da Internet para se conectar aos servidores da web.

As decisões de design que tomaremos para esta configuração são:

- Regiões: us-east-2, us-west-2

- Zonas de disponibilidade: 4

- VPCs: 2

- Sub-redes de rede: 8 (segmentos de rede AWS-native e VMware Cloud on AWS SDDC)

- VMware Cloud on AWS: 4 SDDCs, 1 em cada AZ

- Banco de dados, aplicativos e servidores da Web residem em cada SDDC. Replicação de banco de dados por meio do VMware Transit Connect.

Figura 1 – Application Load Balancer + integração WAF com VMware Cloud on AWS.

Resumo da Implementação

Depois de anotar as decisões de design fundamentais, a implementação seguirá esse processo.

Implantação de VPC

Criação de um VPC em cada região que abrange pelo menos duas zonas de disponibilidade. Isso cria redundância e resiliência no caso de uma única AZ ter uma falha ou uma região inteira estar com problemas. Você tem a opção de criar uma VPC por meio de métodos manuais nos quais será necessário criar sub-redes, tabelas de roteamento e conexões de rede. A outra opção cria esses objetos para você depois de definir algumas opções diferentes.

Implantação de SDDC

Você implantará os SDDCs do VMware Cloud on AWS em cada AZ onde implantou os VPCs. Cada SDDC precisará ser conectado por meio de uma VPC conectada ou aproveitando o VMware Transit Connect ou o AWS Transit Gateway . Dependendo do seu caso de uso, outras considerações de arquitetura podem ser necessárias para sua implantação. O menos complexo seria aproveitar uma arquitetura de VPC conectada, conforme mostrado na Figura 2 abaixo.

Em seguida, implante os SDDCs e continue a configuração enquanto eles estão sendo criados. Esse processo pode levar até duas horas para ser concluído para cada SDDC e eles podem ser implantados em paralelo. As implantações do SDDC são executadas no VMware Cloud Console .

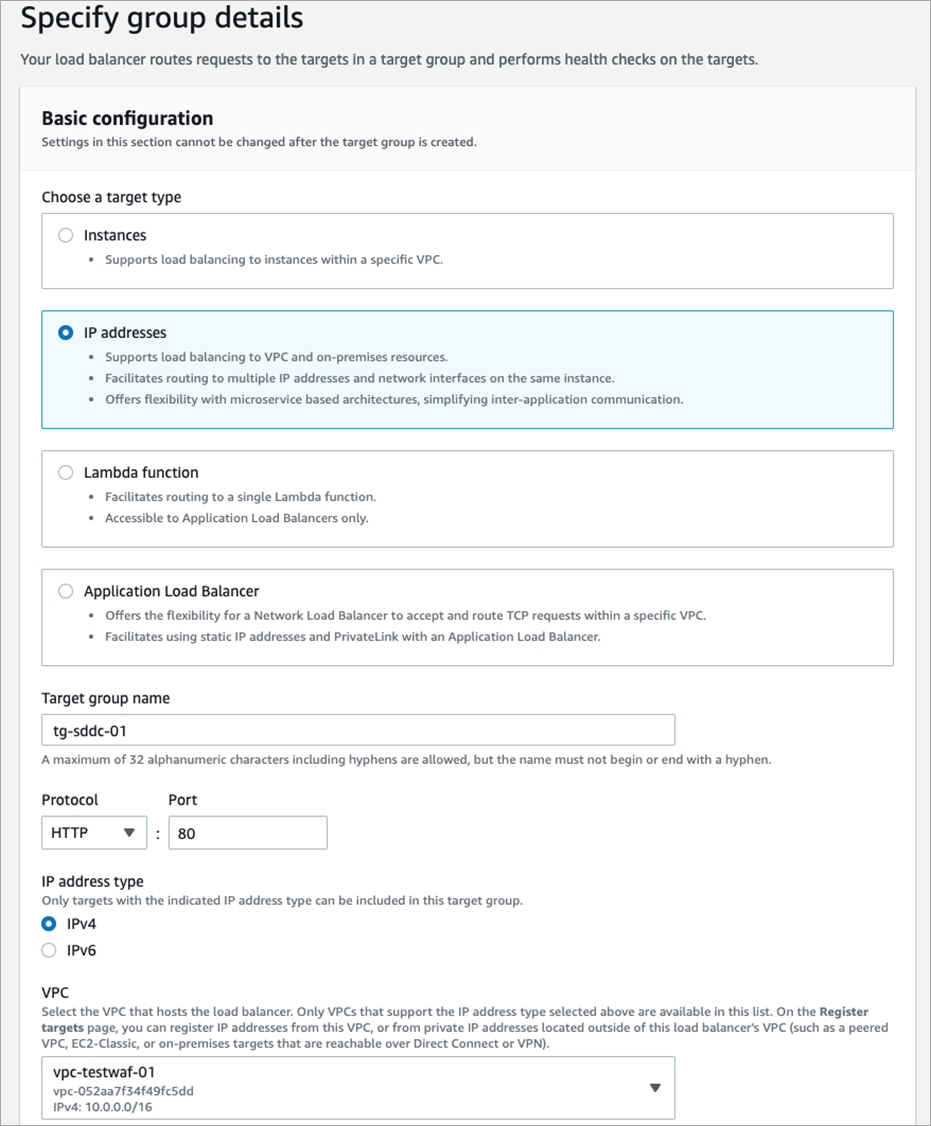

Enquanto os SDDCs são criados, continue a configuração do restante do ambiente. Você criará o grupo de destino do Amazon Elastic Compute Cloud (Amazon EC2) e, com base em nossa decisão de design de servidores web que residem em um segmento de rede SDDC, você escolherá o tipo de grupo de destino Endereço IP .

Figura 2 – Criação do grupo-alvo.

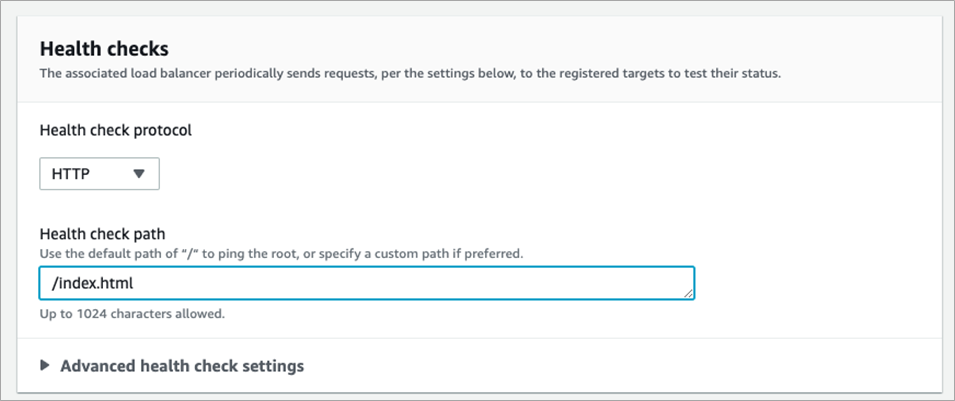

Forneça um nome de destino, escolha a VPC à qual será associada e insira o caminho de verificação de integridade apropriado. No caso de você ter mais de quatro servidores da Web para balancear a carga, vários grupos de destino podem ser criados e associados ao Application Load Balancer (ALB).

Figura 3 – Designação do caminho de verificação de integridade.

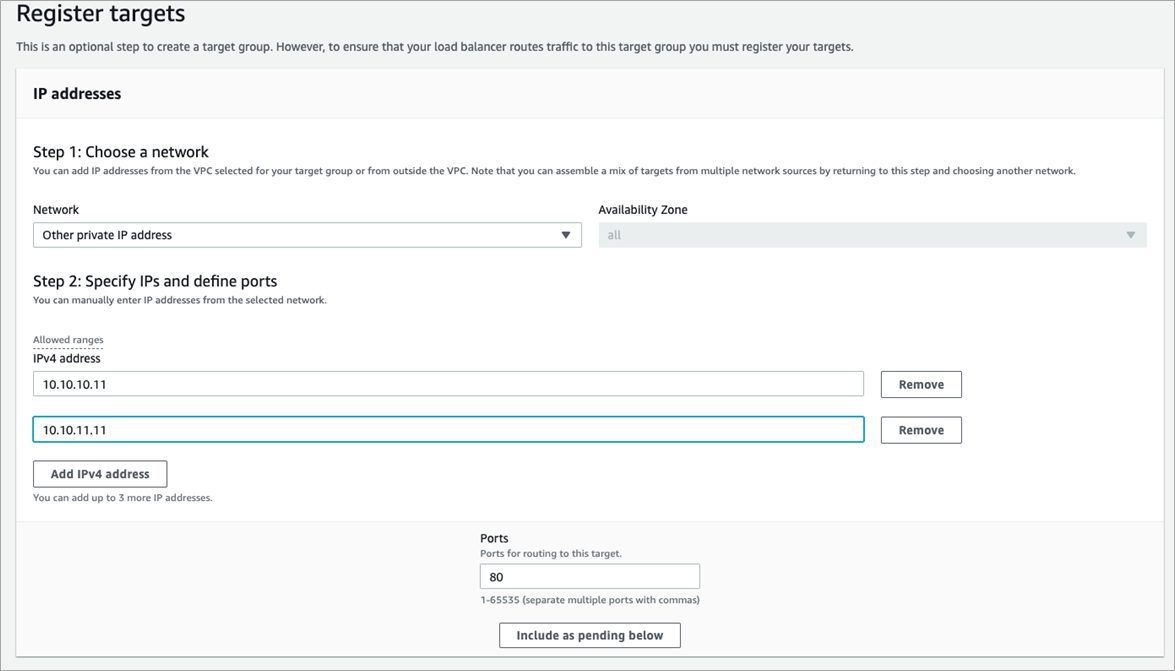

Na próxima etapa, escolha Outro endereço IP privado para a Etapa 1. Em seguida, adicione os destinos específicos que residem nos segmentos SDDC. Os alvos são os endereços IP dos servidores web.

Selecione Incluir como pendente abaixo e a caixa de diálogo final permite visualizar o resumo de destino.

Figura 4 – Criação do IP alvo.

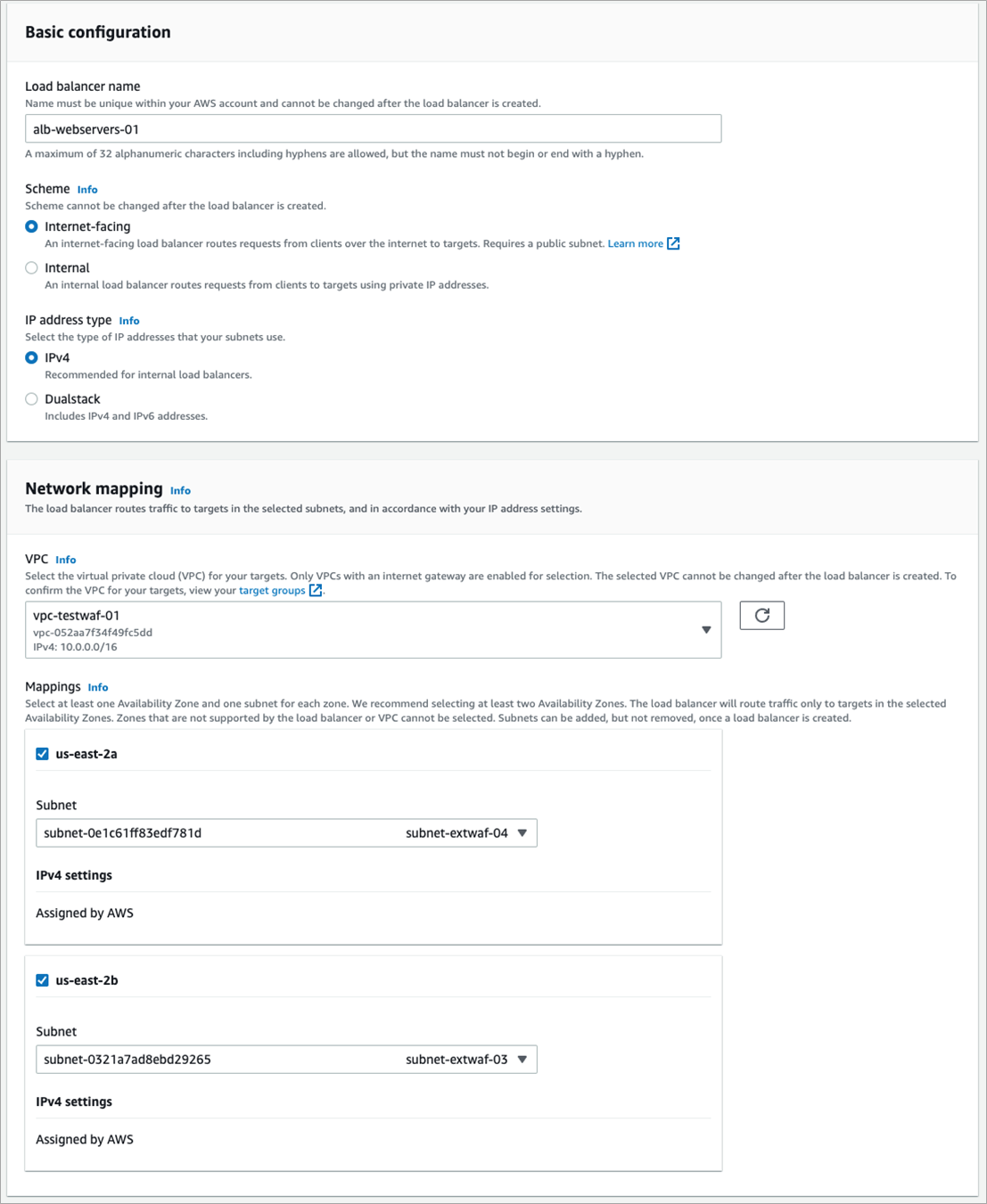

Em seguida, crie um Application Load Balancer e certifique-se de que o esquema voltado para a Internet seja escolhido. Selecione a VPC à qual será anexada e selecione as sub-redes às quais este balanceador de carga fornecerá serviços.

Selecione o security group para permitir a passagem do tráfego da web. Por fim, selecione o grupo de destino para o listener criado na etapa anterior.

Figura 5 – Criação do Application Load Balancer.

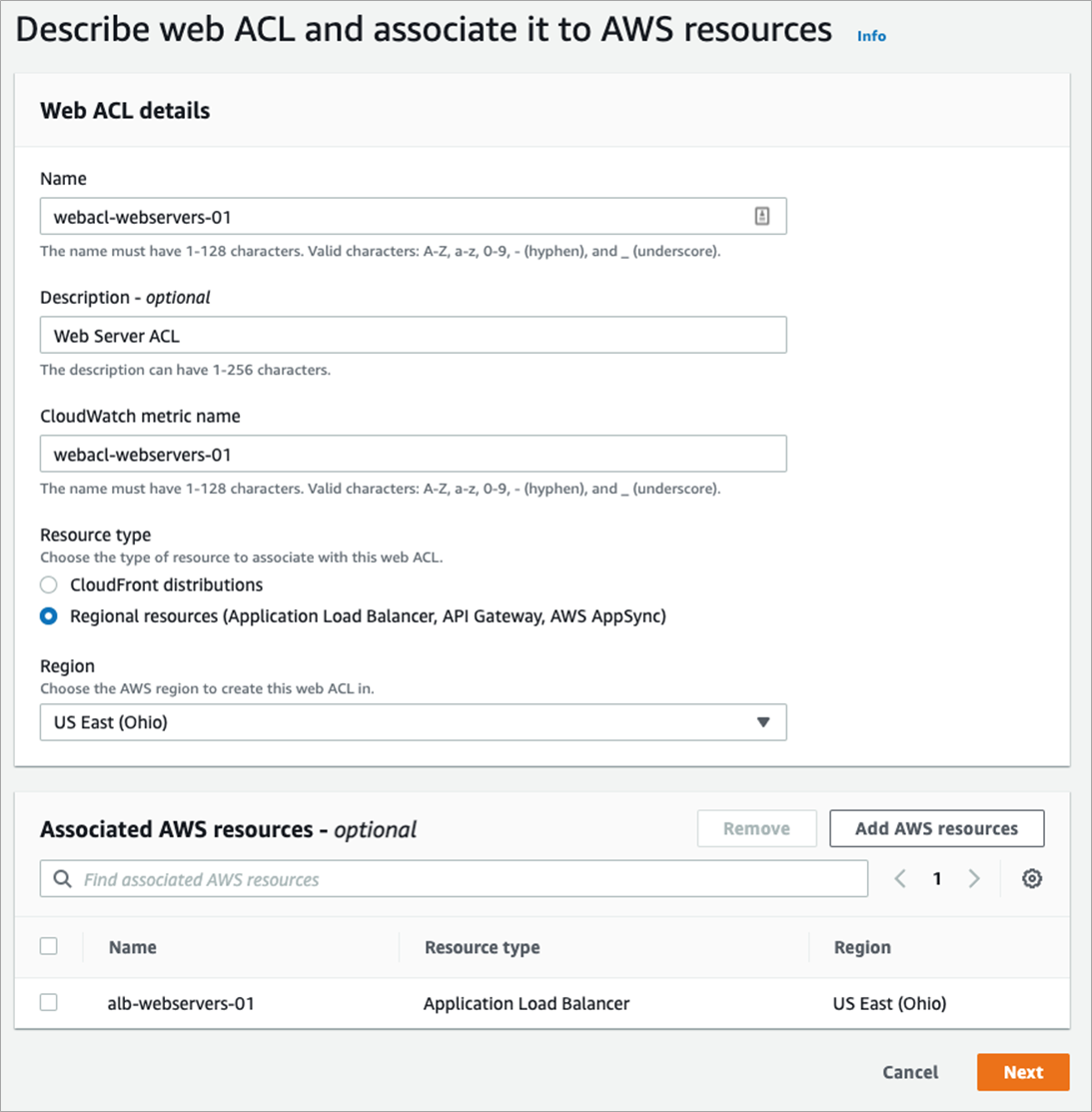

Para anexar controles de segurança ao ALB, crie web ACLs para o WAF. Você pode encontrá-los pesquisando os serviços AWS WAF e AWS Shield ou selecionando o link na guia Integrated Services do ALB.

Figura 6 – Configuração WAF Web ACL.

Ao criar uma WAF ACL, você definirá o nome, o nome da métrica do Amazon CloudWatch e, para este exemplo, Resource type – Regional resource . Essa ACL pode ser anexada a um dos três tipos de recurso e, neste exemplo, você escolherá o ALB criado na etapa anterior.

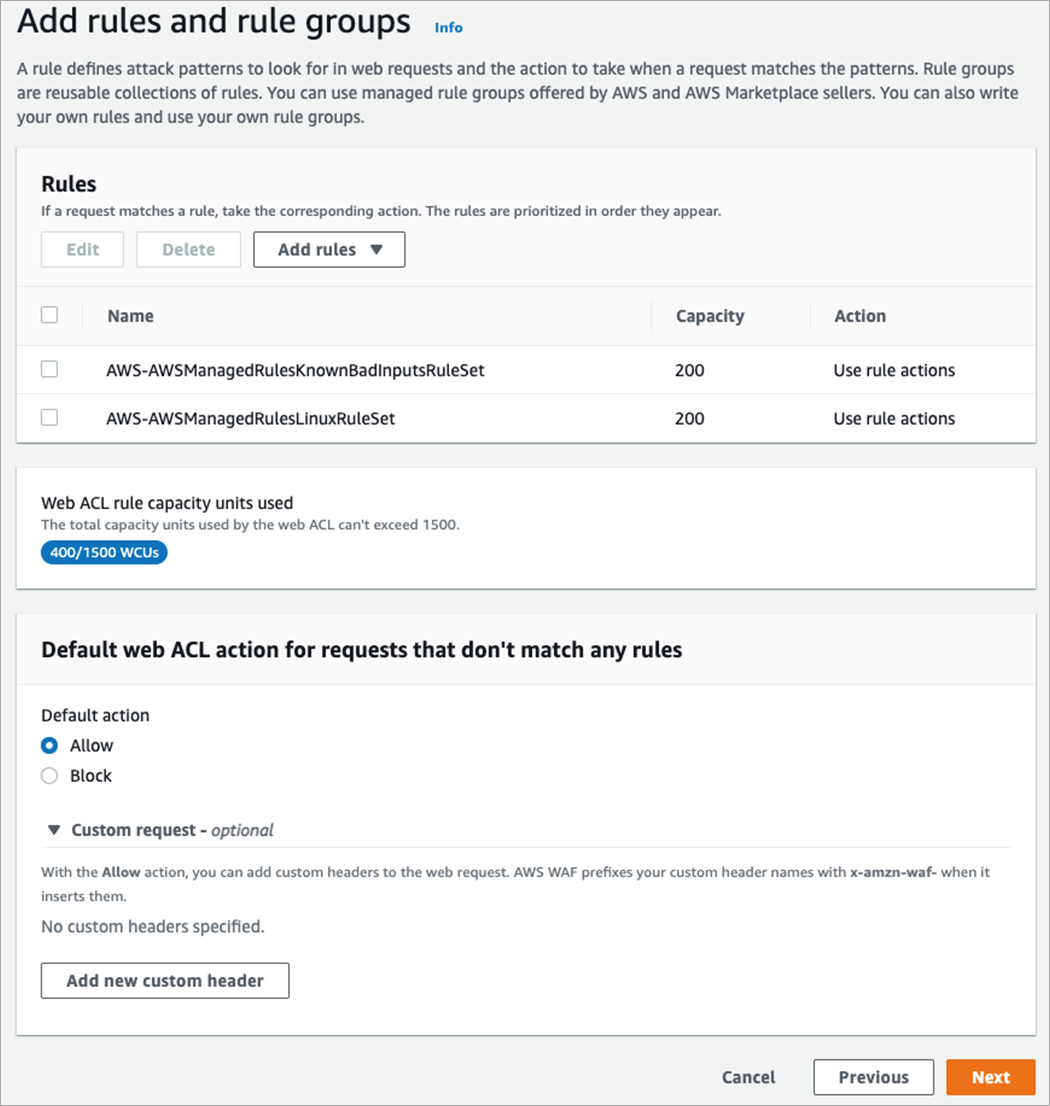

A próxima tela permite que você defina as regras específicas que serão usadas para proteger seus servidores web. Em Adicionar regras, adicione suas próprias regras, bem como as regras gerenciadas da AWS ou de terceiros.

Figura 7 – Definições das regras do WAF.

As próximas etapas permitem escolher a prioridade da regra e as métricas do Amazon CloudWatch. A etapa final permite configurar as métricas de regras específicas e as opções de amostragem.

O último componente a implantar é o Amazon CloudFront, que permite entregar o conteúdo de AZs ou até mesmo regiões e aumenta a segurança de seus aplicativos adicionando vários recursos de proteção. Este serviço unirá nossas duas regiões na entrega de conteúdo para seus usuários.

Depois que os SDDCs forem implantados, crie um grupo SDDC que permitirá que o tráfego flua entre os dois SDDCs por meio do Transit Connect para replicação de banco de dados e outras comunicações de aplicativos. Em uma etapa posterior, você também adicionará as políticas de segurança NSX-T apropriadas.

Depois que isso for concluído, crie o segmento de rede em cada SDDC em que os servidores da Web, de aplicativo e de banco de dados residirão. Você também notará segmentos de rede padrão que são criados durante a criação do SDDC. Eles podem ser excluídos, pois podem se sobrepor a outra sub-rede de rede dentro do seu ambiente.

As seguintes redes foram criadas para este exemplo.

- Webserver-lab-01

- Sub-rede: 10.10.10.1/24

- DHCP: servidor DHCP de gateway

- Intervalo DHCP: 10.10.10.10-10.10.10.250

- Webserver-lab-02

- Sub-rede: 10.11.10.1/24

- DHCP: servidor DHCP de gateway

- Intervalo DHCP: 10.11.10.10-10.11.10.250

Em seguida, crie um grupo de membros de máquina virtual (VM) para os servidores Web que serão associados às políticas de segurança. Aqui, um grupo de computação foi criado e os membros foram definidos pelo nome da VM. Neste exemplo, foi usado “grupo VM começa com” com entrada como “lab-web”. As VMs podem ser implantadas manualmente com esse nome ou um serviço como o vRealize Automation Cloud pode usar automação para definir nomes de VM.

Em seguida, as rotas podem ser verificadas entre os dois ambientes para garantir que foram propagadas corretamente. Estes podem ser visualizados no item Networking & Security em Transit Connect . Outras rotas do Transit Connect podem ser visualizadas no grupo SDDC no menu Roteamento .

Você pode escolher os membros e as tabelas externas no menu suspenso, e a tabela de roteamento VPC pode ser verificada para a tabela de rota anexada ao VPC. Os segmentos de rede NSX-T devem ser propagados para a VPC anexada. Certifique-se de incluir ACLs para permitir o fluxo de tráfego do ALB para os segmentos de rede SDDC.

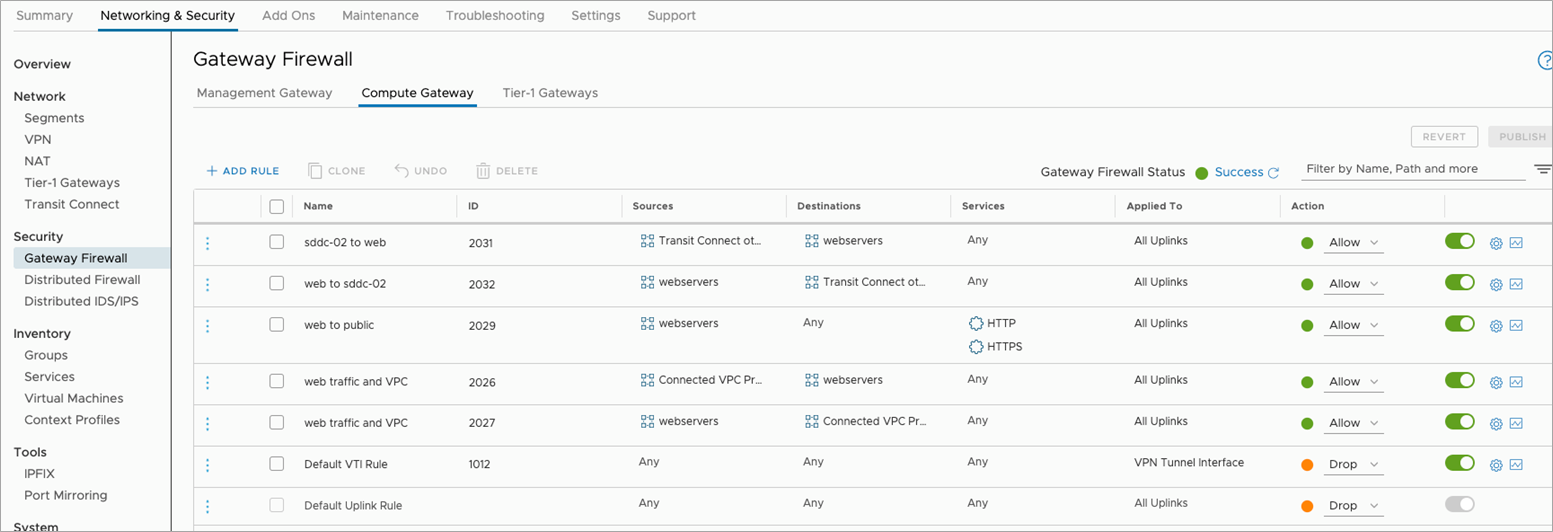

Você precisará permitir que o tráfego flua dos segmentos de rede SDDC para o VPC ALB e, por fim, para a Internet. Para fazer isso, adicione políticas ao gateway de computação SDDC e ao firewall distribuído conforme mostrado abaixo.

Figura 8 – Exemplo de regras de firewall do gateway.

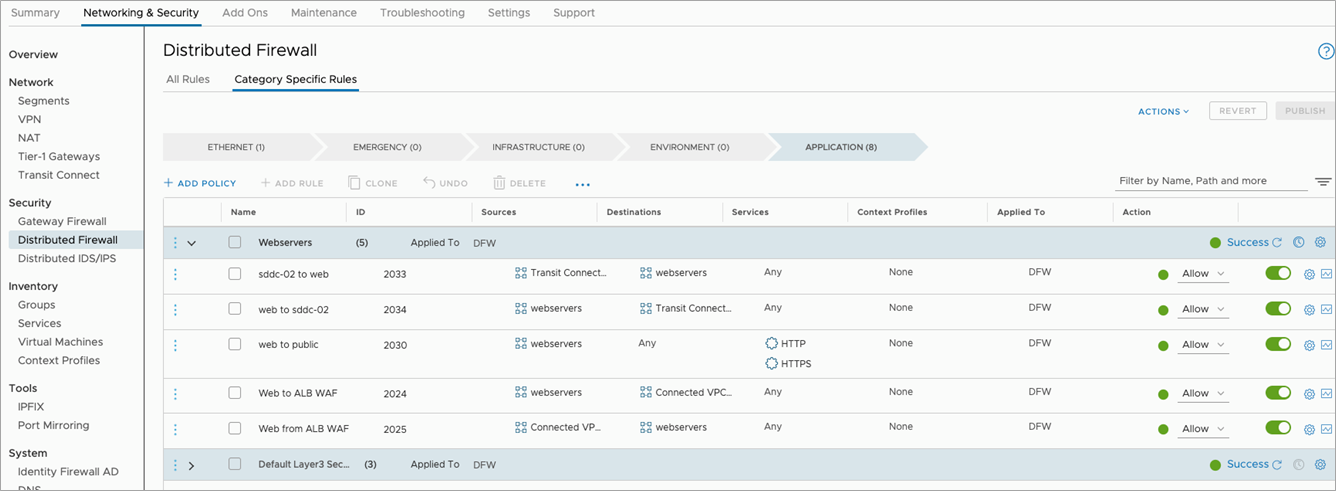

Semelhante ao diagrama acima, regras adicionais são necessárias na seção Distributed Firewall Security. Isso permite que os servidores da web se comuniquem com o AWS Application Load Balancer.

Figura 9 – Exemplo de regras de firewall distribuído.

As etapas finais são implementar as VMs e incluir os endereços IP no grupo de destino associado ao ALB.

Conclusão

Nesta postagem, abordei como integrar as políticas do AWS WAF associadas a um Application Load Balancer para fornecer segurança adicional para aplicativos da Web que residem no VMware Cloud on AWS. Opcionalmente, você pode incorporar instâncias de aplicativos da web baseados no Amazon EC2 para equilibrar seu aplicativo no SDDC e no EC2.